Tidigare beräkningar av AI-systems klimatpåverkan har ofta överskattat el- och vattenanvändning eftersom de inte räknat in alla faktorer i datacentren. Googles nya studie går längre och mäter:

- All faktisk elanvändning: både i AI-chip, processorer, minne och idlande maskiner.

- Datacentersystemens overhead: kylning, strömförsörjning och övrig infrastruktur.

- Vattenåtgång för kylning: i snitt 0,26 milliliter per textfråga – ungefär fem droppar

Jämförelser med andra forskningsrapporter visar att beräkningarna tidigare varierat med upp till en tiopotens – från några tiondelar till flera wattimmar per prompt. Google menar att skillnaden beror på att deras mätning utgår från verklig drift i storskaliga datacenter, där optimeringar som speculative decoding, Mixture-of-Experts-modeller och kvantiserade algoritmer gör systemen mycket effektivare.

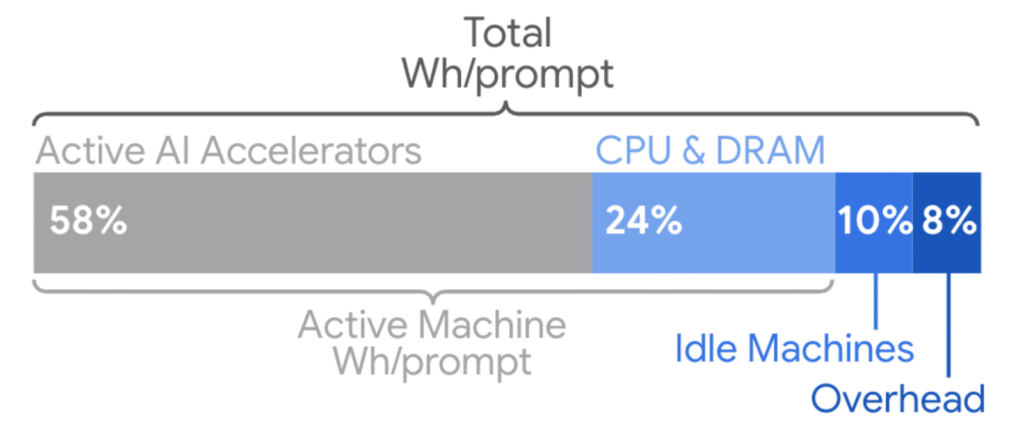

Den största delen av elanvändningen (58 procent) kommer från de aktiva AI-acceleratorerna, följt av CPU och minne (25 procent). Kylsystem och idlande maskiner står tillsammans för cirka 20 procent.

Vad har det för betydelse

Resultaten visar att AI-tjänster, när de körs i optimerade datacenter, kan ha en betydligt mindre klimatpåverkan än vad som ofta påstås. För användare och samhällen betyder det att den stora frågan inte är energin per prompt, utan den samlade volymen. Om miljarder människor använder AI varje dag växer totalförbrukningen ändå snabbt. Men samtidigt pekar Google på att snabba effektivitetsvinster och övergången till fri energi i datacentren gör att ökningen av utsläpp inte behöver följa användningen. Kommuner, organisationer och företag kan därför se AI som ett verktyg för utveckling utan att behöva frukta en explosion av el- och vattenbehov, förutsatt att leverantörerna fortsätter förbättra både teknik och drift.